CVPR23-无需光流引导的视频联合去模糊和插帧transformer:针对真实世界运动模糊的插帧网络

CVPR'23-无需光流引导的视频联合去模糊和插帧transformer:针对真实世界运动模糊的插帧网络¶

Arxiv Link:https://arxiv.org/abs/2211.11423

Code Link:https://github.com/zzh-tech/BiT

解读:Owen

这篇CVPR‘23最新的视频领域工作研究了从运动模糊时序图像中恢复清晰帧的挑战问题,也被称为联合去模糊和插帧或模糊时域超分辨率,旨在从模糊的低帧率输入中恢复出清晰的、高帧率输出。所面临的挑战主要有两方面:1)目前的方法在可视质量方面甚至在合成数据集上仍有相当大的改进空间,2)对真实世界数据的泛化能力较差。为此,我们提出了一个模糊插帧transformer(BiT),以有效地探索和编码在模糊中的底层时序帧间相关性。基于多尺度残差 Swin-tranformer 块,我们引入双端时间监督和时间对称集成策略,为时变运动渲染生成有效的特征。我们还设计了一个混合摄像系统,收集了第一个真实世界数据集,包含一对多的模糊-清晰视频组。实验结果显示,BiT在公共数据集Adobe240上比最先进的方法有显著的提升。此外,所提出的真实世界数据集有效地帮助模型良好地泛化到真实模糊情景

背景&引言¶

除了延时摄影场景外,在拍照过程中,运动模糊通常是最不受欢迎的退化现象之一。许多学者致力于研究如何从模糊中恢复清晰的图像细节,并取得了巨大的进展。最近,学术界开始将注意力集中到更具挑战性的任务上,即从模糊图像中恢复高帧率的清晰视频,这可以被称为联合去模糊和插帧或模糊时序超分辨率任务。这个任务可用于许多应用,如视频视觉感知增强,慢动作生成和快速移动物体分析。为了简洁起见,在这篇工作中,将此任务称为模糊插帧(Blur Interpolation)。

最近的研究表明,联合执行的方法(pipeline)比串联、分开执行的去模糊和视频插帧方法更有效。大多数联合方法都遵循中心帧插值管道,这意味着它们只能递归地为中间时刻生成潜在帧。DeMFI通过结合自引导特征流和像素特征warp-based技术打破了这个限制,以在任意时间t生成潜在的清晰帧。但是,即使在合成数据上,当前方法的性能对于人类感知来说仍远远不够令人满意。我们发现,模糊中潜在的时间相关性被低估了,这为改进模糊插帧算法的性能留下了巨大的空间。此外,由于缺乏真实数据集,模糊插帧面临着泛化问题,这也限制了算法的应用。因此,本文的目标是解决上述两个问题。

针对时间依赖重构和时态对称性属性的复杂分布,我们提出了双端时间监督(DTS)和时域对称集成(TSE)策略,以增强共享的时间特征以进行时变的运动重建。此外,我们还引入了多尺度残差Swin Transformer块(MS-RSTB),以赋予模型有效处理不同尺度模糊和融合相邻帧信息的能力。由于我们的设计,即使没有基于光流的warp操作,BiT在公共基准测试性能上也达到了最先进水平。

同时,为了向学术界提供真实的基准数据,我们设计了一种准确的混合相机系统,捕获了一个新数据集(RBI),其中包含时间对齐的低帧率模糊和高帧率清晰视频对。由于在该真实世界数据集上训练,模糊插帧算法的真实世界泛化问题得到极大的缓解,同时也提供了更合理的评估benchmark来更好的探究模型的性能。

通过这些改进,BiT展示出了令人印象深刻的任意模糊插帧性能。论文贡献可归纳如下: • 提出了一种基于Transformer的新型模型BiT,用于任意时间的模糊运动重建。推理速度更快的同时,BiT和BiT++在定量和定性上都大大优于以前的方法。 • 提出并验证了两种有效的策略,包括双端时间监督和时域对称集成,利用这两种策略可以有效增强任意时间运动重建的共享时间特征。 • BiT提供了第一个用于泛化模糊插帧任务的真实世界数据集。作者团队通过广泛的实验验证了这个真实数据集的有效性,并证明它对视觉社区的关键意义。

方法 Method¶

BiT概览。

在(a)部分中,提出了一种模糊插值变压器,它将三个连续的模糊图像作为输入,生成共享的时序特征。然后,将共享特征和标准化后的时间t合并,以呈现曝光时间内指定时刻的清晰帧。此外,还有一个额外的重构层,其通道数是最终重构层的两倍,用于从共享的特征中重构双端时间点的结果(用于双端时间监督)。(b)部分是多尺度残差Swin变压器块的详细信息。共享的RSTB模块19以一种从粗到细的方式处理模糊并融合相邻的特征。©部分是时间对称集成策略。采用具有新的重构层的预先训练的BiT,以正向(t)和反向(1-t)顺序融合重建特征。

BiT概览。

在(a)部分中,提出了一种模糊插值变压器,它将三个连续的模糊图像作为输入,生成共享的时序特征。然后,将共享特征和标准化后的时间t合并,以呈现曝光时间内指定时刻的清晰帧。此外,还有一个额外的重构层,其通道数是最终重构层的两倍,用于从共享的特征中重构双端时间点的结果(用于双端时间监督)。(b)部分是多尺度残差Swin变压器块的详细信息。共享的RSTB模块19以一种从粗到细的方式处理模糊并融合相邻的特征。©部分是时间对称集成策略。采用具有新的重构层的预先训练的BiT,以正向(t)和反向(1-t)顺序融合重建特征。

下面我们重点介绍BiT模型中的双端时序监督(Dual-end Temporal Supervision, DTS)和 时序对称集成(Temporally Symmetric Ensembling, TSE)。BiT中的MS-RSTB块结构和设计较为简单,略去不细谈,MS-RSTB块在不同scale feature中递归复用同一block来提高特征挖掘效果,其核心模块RSTB和Swin-IR中的基本一致。

双端时序监督(Dual-end Temporal Supervision, DTS)¶

对于时间变化的运动呈现,一个重要的观察是从中间时序帧到时序序列两端,随着时间差异的增加,修复难度也会增加。 作者团队发现,如果模型能够在没有任何时间线索的情况下提取到最极端运动时刻的相关特征,那么这些特征可以很好地适应其他时刻的运动呈现。 因此,作者团队提出了一种名为双端时间监督(DTS)的学习策略,来加强共享的时间特征的学习,并将特征在时间上的变化传递下去。具体来说,BiT使用一个轻量级的重建层FRD来强制重建两端时间点的运动,并且不使用任何时间编码信息。注意,这个额外的重建层在推理、测试中不会被使用,只是为了加强模型对时序输入边界的收敛,从而更好地探索随时间变化的运动模糊,如上图中子图(a)部分所示,DTS利用一个独立的layer来从黄色块表示的共享特征中强制重建时序两端的清晰帧,在该重建过程中,不使用任何时间信息t相关的编码特征。DTS提供作为边界的锚点,使共享的时间特征更有利于以连续时间的方式呈现运动。

时序对称集成(Temporally Symmetric Ensembling, TSE)¶

作者在BiT中提出的另一关键insight是,在可变时间运动模糊序列中,输入序列的前向过程和逆向过程有着较一致的运动模糊退化情况,因此,将原本的三帧输入进行反转,如上图c图所示,设输入三帧为{I_{pre},I_{cur},I_{nxt}},反转为:{I_{nxt},I_{cur},I_{pre}},接着,利用pre-trained的BiT model和一个新的重建层来融合这两个输入的特征,从而得到更优的新输出。实验表明,经过TSE策略增强后,将获得更优的性能结果。

真实世界 Blur Interpolation 数据集¶

真实世界 Blur Interpolation 数据集示例。

真实世界 Blur Interpolation 数据集示例。

(a) 是来自合成数据集Adobe240的样本,其中模糊轨迹中存在异常的尖峰或步跃。 (b) 是作者团队使用的混合摄像系统的示意图。 © 是来自我们的现实世界数据集RBI的自然模糊样本。

针对前文提到的数据集缺陷问题,作者团队开发了一套混合摄像系统用于收集真实世界的Blur Interpolation 数据集,即数据集RBI (real-world blur interpolation (RBI) dataset),如图中所示,我们可以看出合成的blur dataset本身有着明显缺陷,利用混合摄影系统拍摄的数据集RBI中的样本有着更自然的真实世界运动模糊。

实验¶

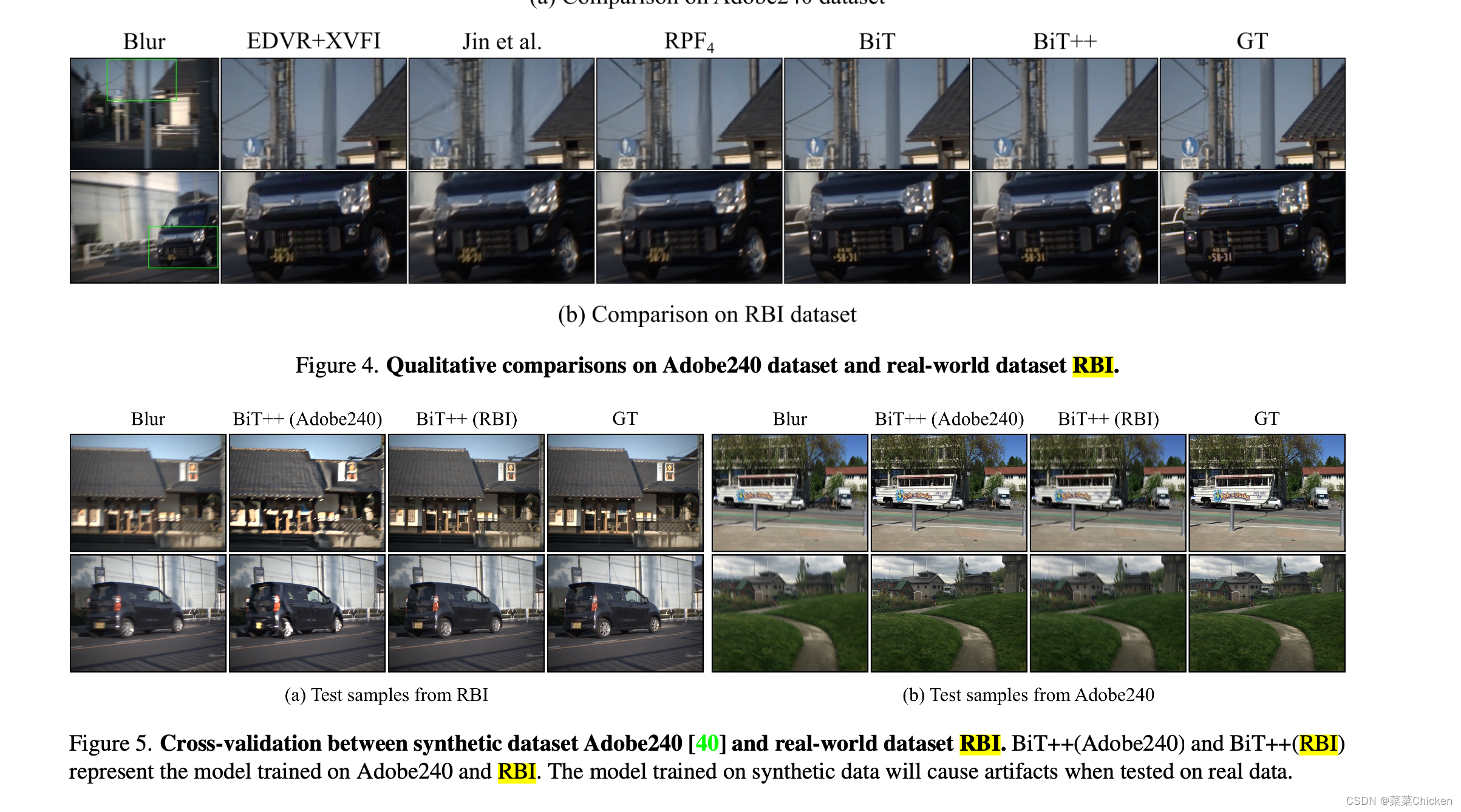

从主观对比结果图可以看出,BiT和应用了TSE的BiT++有着相当不错的主观效果,光流预测也更接近groundtruth,物体细节恢复的非常不错。

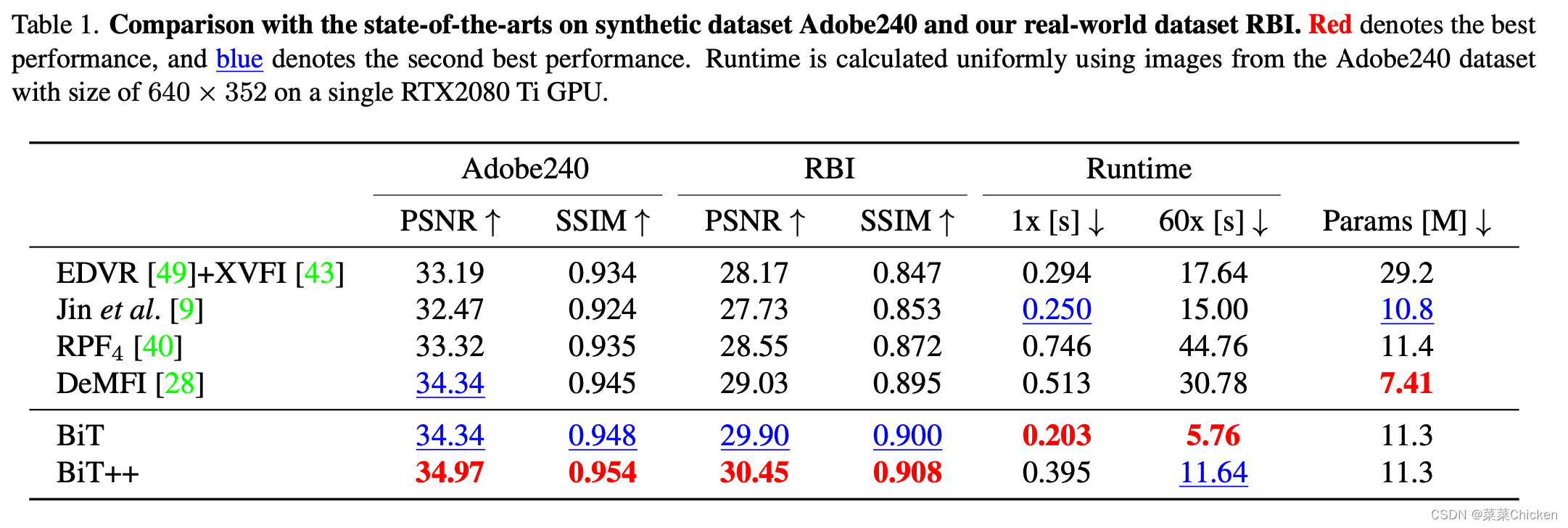

上图中的表格展示了定量结果。我们用TSE策略命名我们的模型为BiT++,不使用该策略的为BiT。BiT++在Adobe240和RBI上表现优异,远远超过先前的方法。此外,从相同输入派生更多的插帧结果,BiT效率更高,在5.76秒内实现了60次推理,同时仍然保持了优异的性能。

结论¶

这篇工作提出了一种新颖而高效的模型 BiT,以最先进的性能实现任意时间的模糊视频插帧和去模糊。 该工作提供了真实世界的数据集 RBI,为模糊插值任务提供了第一个真实世界基准。实验结果表明,提出的方法在合成和真实数据集上都优于现有方法。同时该工作存在一些局限性,例如提出的数据集在应对非常快的动作方面的离散监督有限,未来需要扩展数据集以包括不同设备在不同的曝光参数下拍摄的视频对。

本文总阅读量次